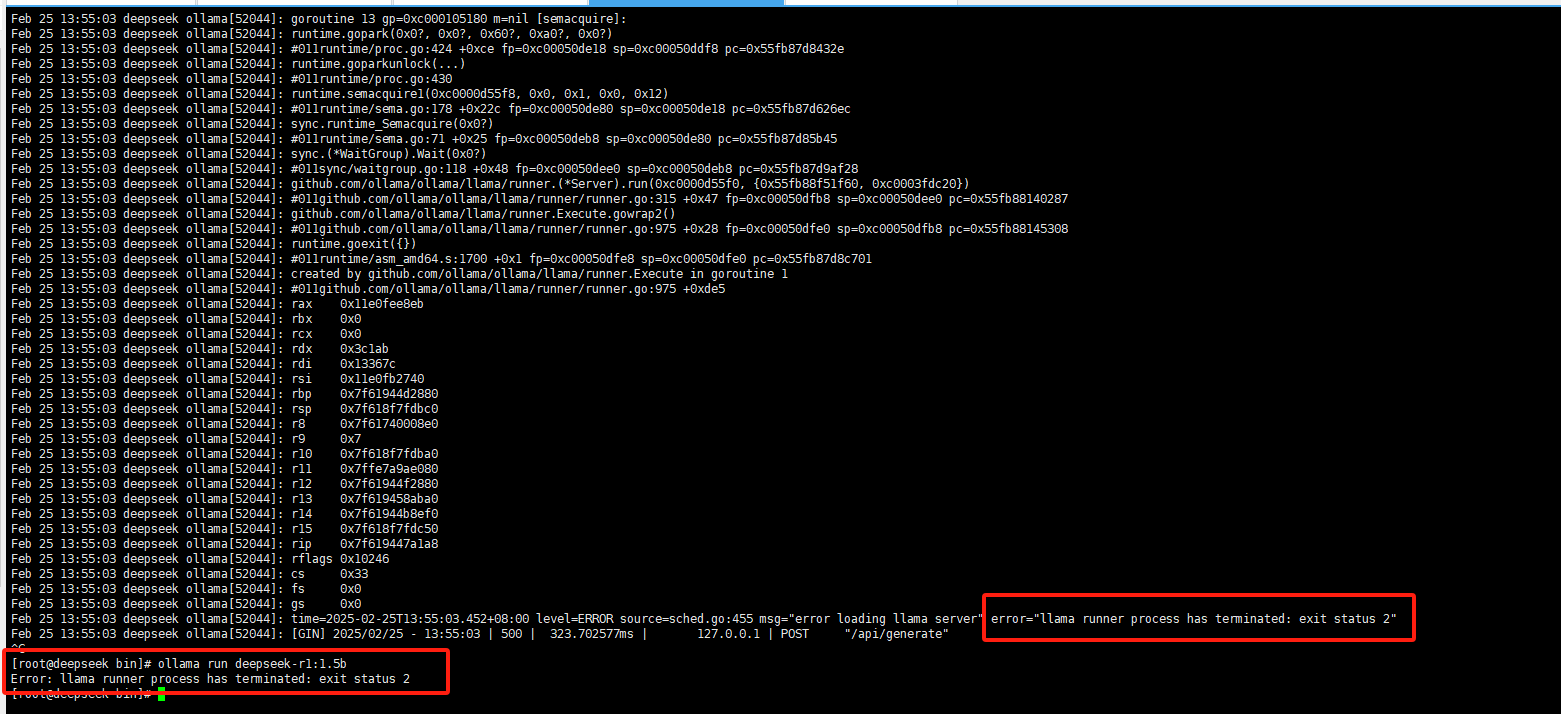

openEuler release 24.03系统使用ollama运行deepseek模型报错level=ERROR source=sched.go:455 msg=“error loading llama server” error=“llama runner process has terminated: exit status 2” ,请问怎么处理

ollama 的启动命令是什么呢

服务是后台运行的:nohup ./ollama serve &

但是一运行模型就报错了

看看 ollama 服务本身有无报错呢

报错就是上面截图的报错,输入的日志在message中了